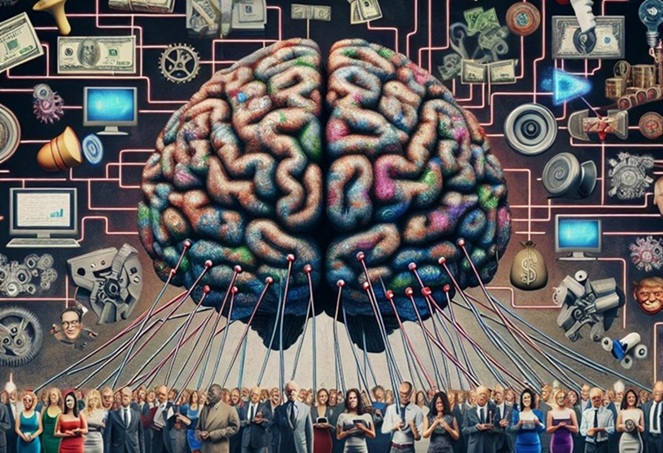

L’intelligenza artificiale viene commercializzata come neutrale, obiettiva e inevitabile; ci viene detto che gestirà i mercati, ottimizzerà la medicina, guiderà l’istruzione e persino assisterà la governance.

Dietro al marketing, però, si nasconde una questione molto più seria: chi controlla questi sistemi e in che modo tale potere ridisegnerà la conoscenza, l’economia e la libertà umana? (Il vecchio Giovenale, che la sapeva lunga, si domandava infatti “…sed quis custodiet ipsos custodes?”, N.d.T.)

L’IA non è una forza autonoma: è finanziata, addestrata, filtrata e applicata da governi, agenzie militari, società e istituzioni finanziarie. Come qualsiasi strumento, può essere utilizzata per costruire o per dominare; ciò che conta non è solo l’intelligenza artificiale in sé ma, bensì, le strutture di potere che la sostengono.

Oggi, quel potere si sta consolidando rapidamente.

1 – Chi controlla l’IA controlla la narrativa

Ogni set di dati riflette decisioni editoriali e ogni algoritmo riflette scelte politiche; ciò che un tempo le aziende di social media imponevano attraverso eserciti di moderatori, ora l’IA lo impone in modo istantaneo e invisibile:

- Quali informazioni appaiono autorevoli?

- Quali interpretazioni storiche sembrano legittime?

- Quali posizioni economiche e scientifiche vengono alimentate?

L’intelligenza artificiale non si limita a moderare il discorso, ma struttura sempre più ciò che può essere conosciuto.

La politica climatica ne è un esempio lampante. La maggior parte dei principali sistemi di intelligenza artificiale riproduce in modo affidabile solo la narrativa climatica ufficiale, mentre le opinioni scientifiche dissenzienti raramente vengono alla luce. La contraddizione è sorprendente: le stesse aziende che promuovono le dottrine di limitazione delle emissioni di carbonio gestiscono centri dati che consumano l’energia di piccole città.

A livello politico, la dottrina sul clima sta passando dalla disputa scientifica all’applicazione amministrativa. L’uso del carbonio diventa un punteggio di rischio digitale, la “sostenibilità” diventa una metrica di conformità programmabile. Ho esaminato le basi scientifiche e politiche di questa ortodossia climatica nel libro “Climate CO₂ Hoax” (La bufala climatica della CO2). L’intelligenza artificiale fornisce sempre più spesso i meccanismi per eseguire questi controlli in modo automatico, aggirando il dibattito pubblico.

Poiché l’output delle macchine appare impersonale, esso trasmette un’autorità che i messaggi politici non possono avere. È così che la gestione narrativa si evolve in governance automatizzata.

2 – Quando il lavoro scompare, il sistema si rompe

Il dibattito pubblico si concentra sui lavori che l’intelligenza artificiale eliminerà; la domanda più importante è se l’attuale struttura economica possa sopravvivere all’automazione di massa.

Alcune previsioni suggeriscono che fino a un terzo o più del lavoro amministrativo e professionale potrebbe diventare superfluo. Il problema non è semplicemente la disoccupazione, ma il potenziale crollo della domanda dei consumatori stessa. Un’azienda che sostituisce la maggior parte dei propri lavoratori con macchine erode anche la propria base di clienti.

Un sistema che automatizza la propria forza lavoro finisce per automatizzare anche i propri consumatori. L’economia delle macchine non può acquistare la propria produzione.

Il capitalismo, il socialismo e il comunismo differiscono per quanto riguarda la proprietà e la distribuzione, ma tutti presuppongono che il lavoro umano rimanga centrale nella creazione di valore. Quando i sistemi meccanici svolgono la maggior parte del lavoro produttivo e amministrativo, le fondamenta di ogni modello economico vengono minate.

Il reddito di base universale viene spesso presentato come un ammortizzatore umano; in realtà, rischia di creare uno stato sociale programmabile, un sistema di dipendenza digitale in cui la sopravvivenza è legata al rispetto di regole algoritmiche centralizzate. Ciò segna un passaggio dalla politica economica classica a una nuova forma di welfare programmabile e di controllo comportamentale.

3 – L’IA come conoscenza filtrata, non come verità oggettiva

Come ho scritto in precedenza, l’IA non è una mente pensante: un sistema di riconoscimento dei modelli e un motore di previsione statistica addestrato su vasti set di dati selezionati. Non coglie la verità, ma riproduce modelli a partire dalle informazioni che i suoi sviluppatori le consentono di vedere.

Su argomenti delicati di natura politica, scientifica ed economica, ampie sezioni di dati vengono escluse dall’addestramento o dall’output attraverso la politica della piattaforma, la gestione del rischio aziendale e la pressione istituzionale. Ciò che non rientra nel consenso tecnocratico scompare silenziosamente.

Il pericolo non è l’errore casuale. È il pregiudizio sistematico mascherato da intelligenza neutrale.

Come ho descritto in “Staying Human in the Age of AI” (Restare umani nell’era della IA), le scoperte umane raramente derivano da medie statistiche: derivano dalla consapevolezza, dal dissenso, dall’intuizione, dall’intuizione, dall’ispirazione, qualità innate che nessun algoritmo può replicare. Quando ipotesi errate vengono incorporate nei sistemi automatizzati, le loro distorsioni si propagano nella società alla velocità delle macchine.

4 – L’IA come sistema operativo di un’economia tecnocratica e di uno Stato amministrativo

L’IA sta rapidamente diventando il sistema operativo dell’economia globale, un’infrastruttura che integra finanza, industria, amministrazione e governance. Consideriamo il panorama:

- Il trading algoritmico domina i mercati finanziari.

- La massiccia espansione dei data center gonfia il PIL, sostituendo al contempo la manodopera tradizionale.

- Le agenzie federali collaborano con le aziende di IA attraverso programmi di difesa, energia, sicurezza nazionale e la Missione Genesis.

- I fondi pensione e i portafogli dei fondi sovrani sono sempre più legati alle società che dipendono dall’IA.

L’intera infrastruttura dell’IA, compreso “l’esercito dei data center”, non è stata guidata dalla domanda del mercato: è stata resa possibile solo perché, negli ultimi anni, il sistema monetario basato sul debito ha inondato l’economia di credito facile attraverso un’aggressiva espansione monetaria, con investimenti che dovrebbero superare i settemila miliardi di dollari entro il 2030. L’ironia è che questi migliaia di miliardi avrebbero potuto ricostruire l’industria americana, rafforzare le comunità e rilanciare la reale capacità produttiva, invece di sovvenzionare un sistema automatizzato che sostituisce proprio quei lavoratori il cui reddito futuro e i cui contributi fiscali sono in ultima analisi utilizzati per ripagare il debito pubblico. Si tratta di bisogni umani reali, non di vanitosi progetti tecnocratici.

E non è un caso che il debito americano e globale – pubblico, privato e aziendale – abbia ormai raggiunto livelli nominali record, con un aumento dei prestiti soprattutto dopo la “crisi” del COVID-19.

Questo consolidamento è rafforzato da strutture globali: punteggi ESG, infrastrutture digitali pubbliche sostenute dal WEF, sistemi di identità digitale e forme emergenti di moneta programmabile. Una volta che l’accesso finanziario diventa condizionato dal punteggio algoritmico, la libertà non svanisce attraverso una coercizione palese: scompare attraverso la partecipazione condizionata. Si tratta di una forma di gestione centrale algoritmica mascherata da innovazione, che rispecchia sempre più la reincarnazione digitale della pianificazione centrale in stile comunista.

Come ci ricorda il salvataggio delle banche private del 2008, quando i sistemi sono considerati dai poteri finanziari e politici “troppo strategici per fallire”, la ricchezza pubblica sostiene il potere tecnologico privato. Il rischio viene socializzato, il controllo è centralizzato, i profitti rimangono privatizzati, l’economia smette lentamente di servire la vita umana e la vita umana viene riorganizzata per servire l’economia delle macchine.

5 – La colonizzazione della mente – L’IA nelle università americane

L’istruzione superiore offre un caso di studio rivelatore.

Gli studenti ora utilizzano l’IA per fare i compiti; i professori utilizzano l’IA per valutarli e gli amministratori riducono il personale docente mentre acquistano piattaforme di apprendimento basate sull’IA. Ad esempio, il sistema della California State University ha annunciato una partnership da 17 milioni di dollari con OpenAI, promettendo una “iniziativa pubblico-privata altamente collaborativa”.

Sotto la bandiera dell’“innovazione”, le università si trasformano in:

- fabbriche di credenziali

- burocrazie di sorveglianza che utilizzano analisi, controllo biometrico e tracciamento del comportamento

- fornitori di dati per piattaforme aziendali

Un’università che automatizza il pensiero cessa di essere un’università: diventa un sistema di formazione alla conformità per un ordine amministrativo guidato dalle macchine.

Quando le macchine generano contenuti, li valutano e ne certificano il merito, il giudizio umano e la messa in discussione della narrazione vengono silenziosamente rimossi dal ciclo. L’istruzione diventa l’elaborazione di dati piuttosto che la ricerca della verità.

6 – Il rischio maggiore: la delega del giudizio

L’intelligenza artificiale eccelle nel calcolo delle probabilità; non è in grado di cogliere il significato, la coscienza o le conseguenze morali. Eppure le istituzioni moderne esternalizzano sempre più spesso proprio queste facoltà umane.

L’intelligenza artificiale influenza ormai le decisioni finanziarie, il triage medico, la valutazione del rischio legale, la governance del linguaggio e la valutazione educativa. Ogni delega sembra efficiente; insieme, formano un silenzioso trasferimento del giudizio umano al processo di macchina.

Una società che automatizza il giudizio finisce per dimenticare come giudicare. Col tempo, le popolazioni iniziano a ripetere narrazioni e priorità generate dalle macchine, scambiandole per proprie. La realtà consensuale non è plasmata principalmente dal dibattito pubblico, ma dall’architettura digitale. In poco tempo, la società diventa un circuito chiuso: la macchina che parla a se stessa attraverso di noi.

Una domanda fondamentale è: chi programma i valori e chi beneficia dei risultati?

Conclusione: l’illusione dell’IA

L’IA viene sempre più spesso considerata non come uno strumento, ma come un’autorità amministrativa che governa la conoscenza, l’economia e il comportamento. L’illusione è che essa sappia tutto; il pericolo è che la società inizi a confondere il calcolo con la saggezza.

Senza un giudizio indipendente, la tecnologia perfeziona i sistemi di controllo piuttosto che quelli di libertà. Una civiltà che delega le proprie decisioni alle macchine non diventa illuminata: viene gestita in modo efficiente.

Il futuro non sarà determinato da algoritmi migliori, ma dal fatto che gli esseri umani conservino il coraggio di esercitare il proprio giudizio di fronte all’autorità automatizzata.